La inteligencia artificial ha recorrido un fascinante camino desde sus primeros conceptos teóricos hasta convertirse en una tecnología que transforma cada aspecto de nuestras vidas.

Aquí encontrarás una introducción al fascinante trayecto de la IA, diseñada para descubrir sus raíces y entender por qué hoy está tan presente en nuestra realidad cotidiana.

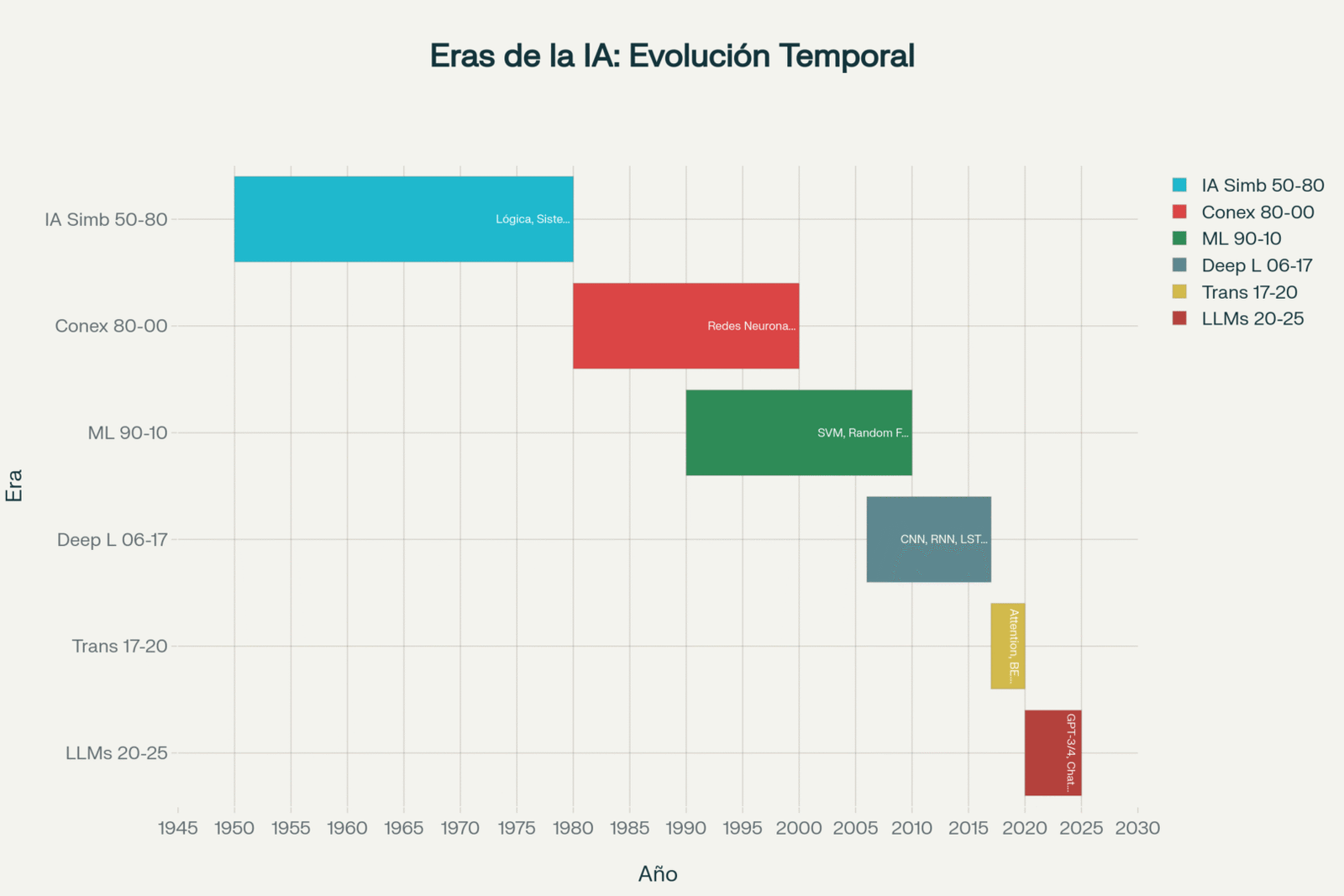

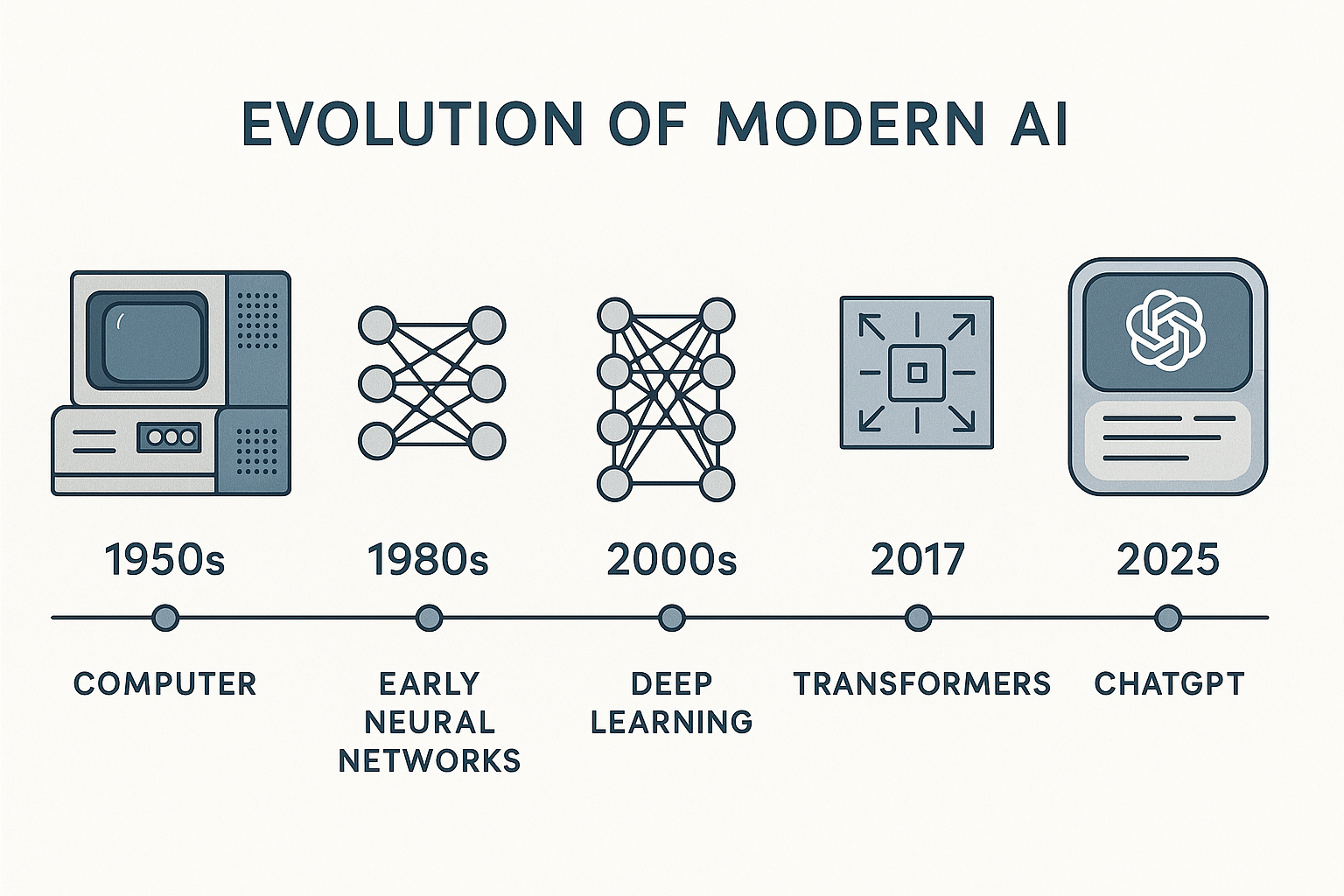

Para entender dónde estamos hoy y hacia dónde nos dirigimos, es fundamental comprender cómo hemos llegado hasta aquí. Este artículo explora la evolución cronológica de los paradigmas de IA, mostrando cómo cada avance ha sentado las bases para las revoluciones que vivimos actualmente con sistemas como ChatGPT, GPT-4 y los modelos de IA generativa.

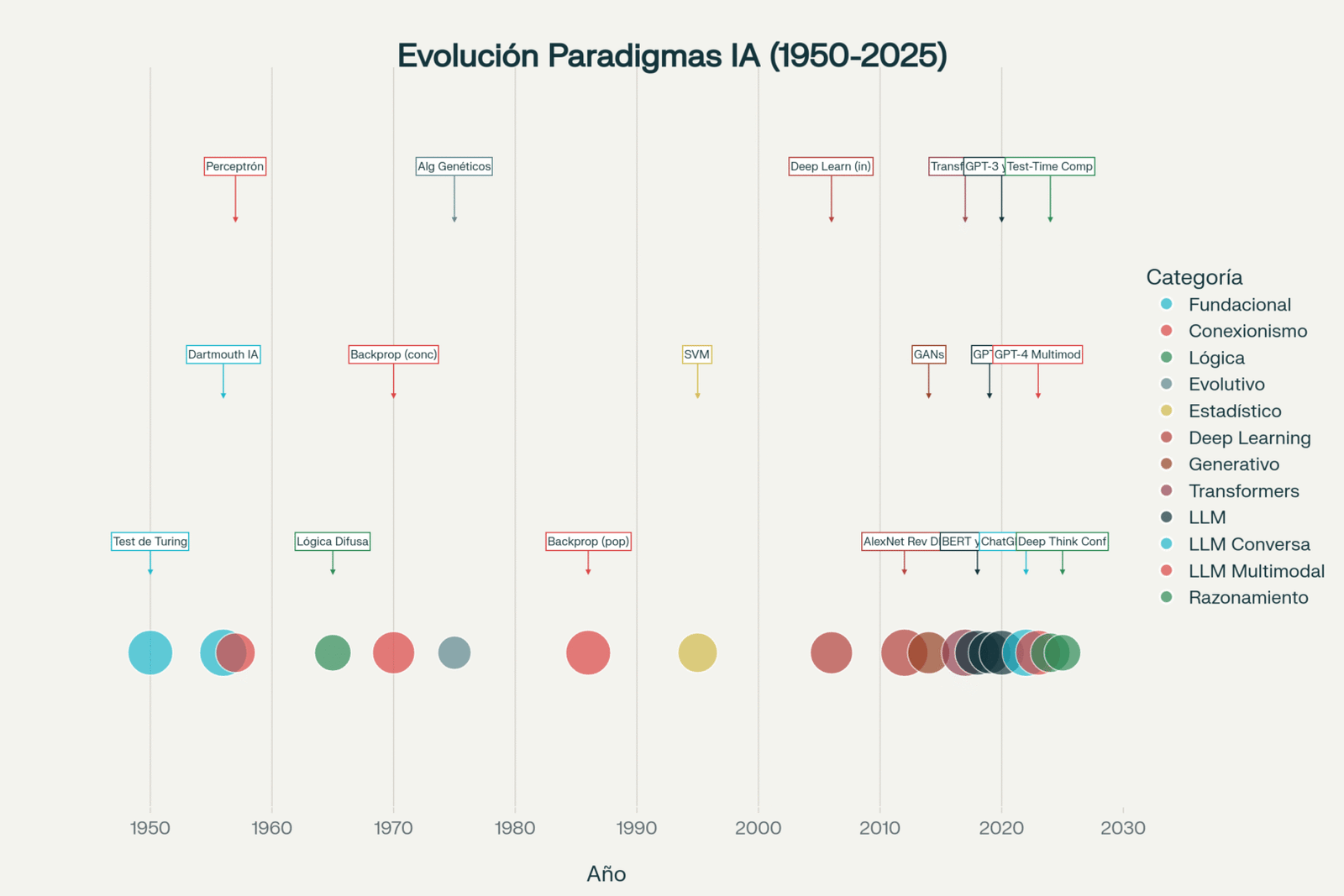

La historia de la IA no es lineal; es una narrativa de momentos eureka, inviernos prolongados y renacimientos espectaculares. Desde el Test de Turing hasta los modelos de razonamiento con confianza interna, cada paradigma ha aportado piezas esenciales al puzzle de la inteligencia artificial moderna.

Los Cimientos Teóricos: La Era Fundacional (1940s-1960s)

El Nacimiento de las Ideas Revolucionarias

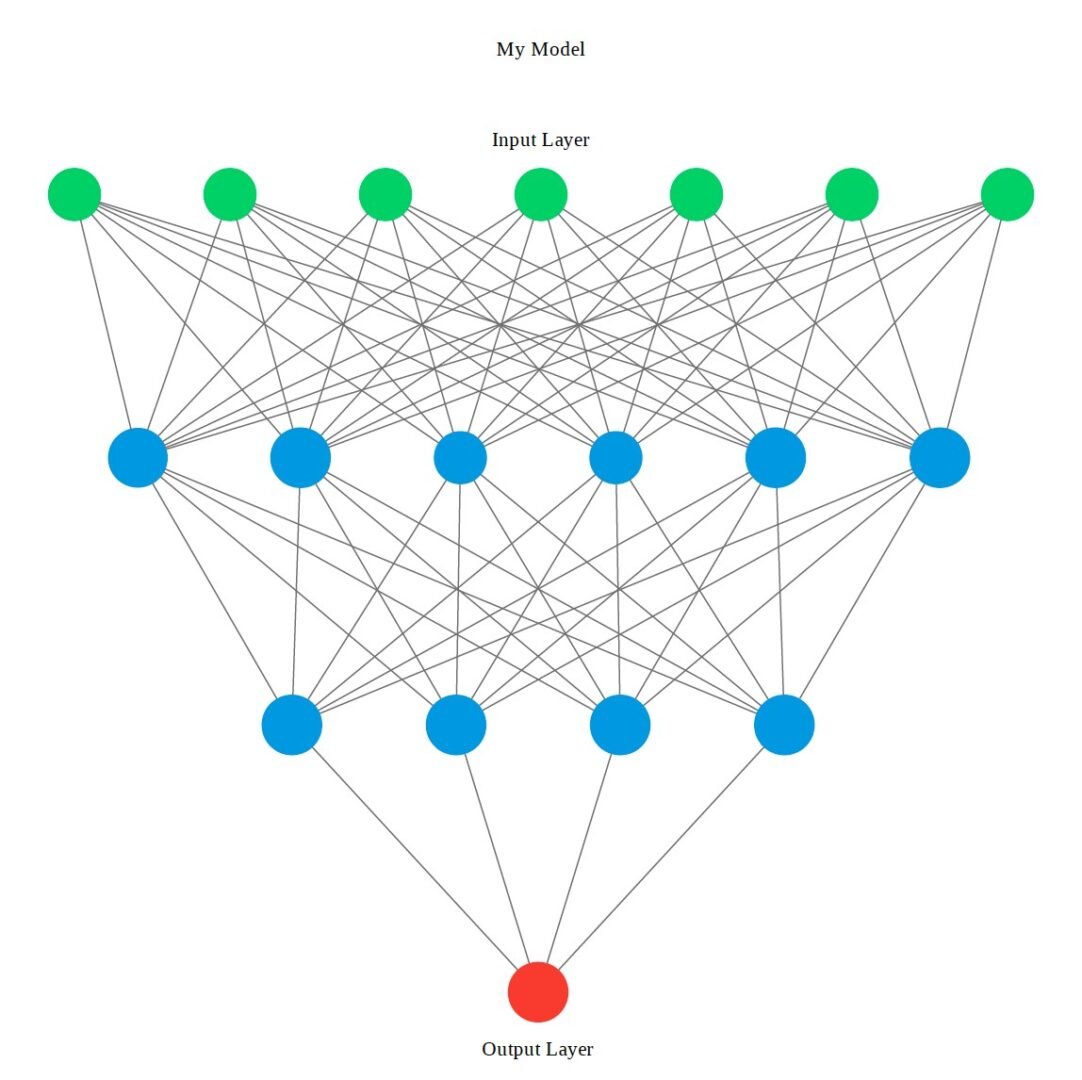

Los fundamentos de la inteligencia artificial se gestaron en una época donde la computación misma era una idea revolucionaria. En 1943, Warren McCulloch y Walter Pitts publicaron un trabajo seminal que demostraría ser profético: «Un cálculo lógico de ideas inmanentes en la actividad nerviosa». Este estudio presentó el primer modelo matemático de red neuronal artificial, mostrando que las conexiones entre neuronas artificiales podían aprender por ensayo y error, reforzando las conexiones que conducían a acciones correctas y debilitando las erróneas.

Alan Turing, considerado el padre de la computación moderna, estableció en 1950 los criterios fundamentales para evaluar la inteligencia artificial. Su famoso Test de Turing propuso una prueba conductual: si una máquina podía mantener una conversación indistinguible de la humana, podría considerarse inteligente. Esta idea, aparentemente simple, estableció uno de los objetivos más duraderos de la IA: crear sistemas capaces de emular el razonamiento y la comunicación humana.

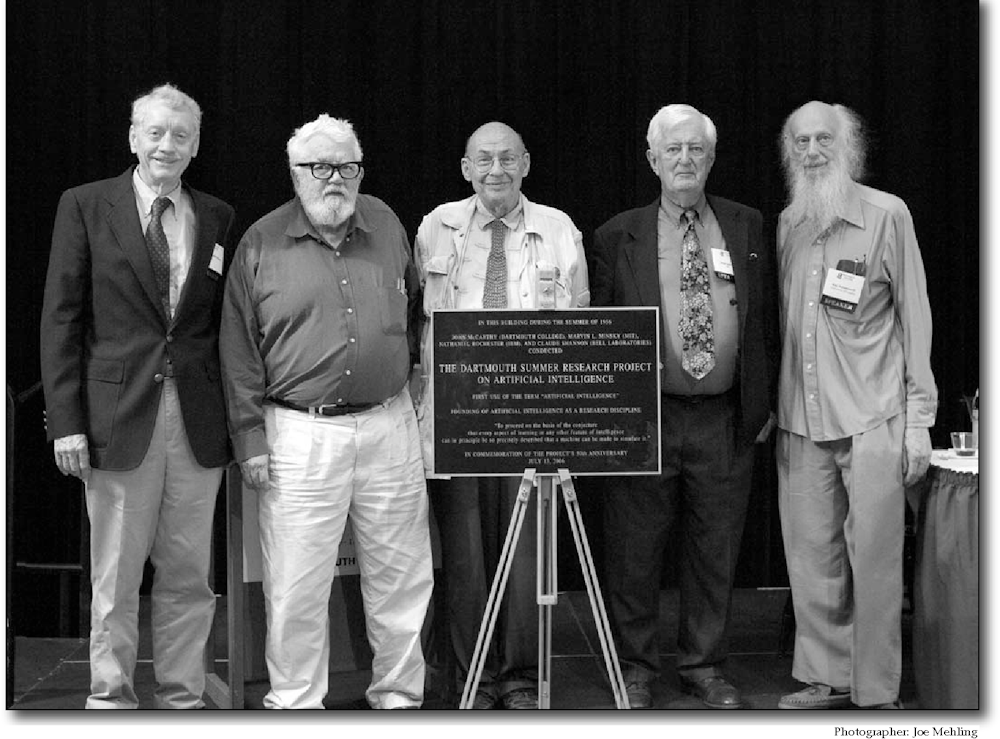

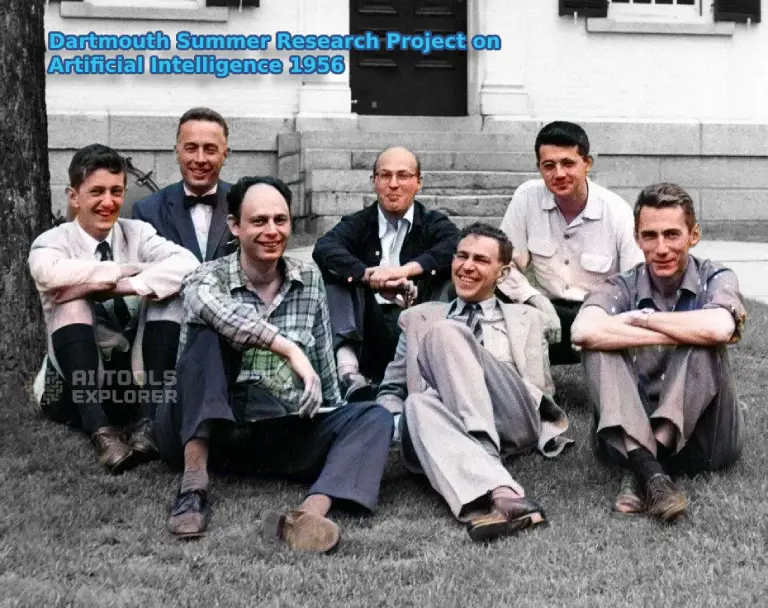

La Conferencia de Dartmouth: El Momento Fundacional

El verano de 1956 marca oficialmente el nacimiento de la inteligencia artificial como disciplina científica. La Conferencia de Dartmouth, organizada por John McCarthy, Marvin Minsky, Claude Shannon y Nathaniel Rochester, no solo acuñó el término «inteligencia artificial», sino que estableció la agenda de investigación que seguiríamos durante décadas.

En esta histórica reunión, los participantes declararon audazmente que «cada aspecto del aprendizaje o cualquier otra característica de la inteligencia puede describirse de tal manera que una máquina pueda simularla». Esta declaración de principios sentó las bases de la IA simbólica, el primer gran paradigma que dominaría las décadas siguientes.

La Era Dorada de la IA Simbólica (1950s-1980s)

Los Sistemas Expertos y el Razonamiento Lógico

Durante estas décadas, la IA se basaba en la premisa de que la inteligencia podía codificarse mediante reglas explícitas y lógica formal. Los sistemas expertos como MYCIN (1971-75), diseñado para diagnóstico médico con 600 reglas, ejemplificaban este enfoque. MYCIN fue calificado como «el abuelo de los sistemas expertos», demostrando que el conocimiento humano especializado podía formalizarse en reglas IF-THEN.

La programación lógica encontró su expresión más refinada en PROLOG (1972), desarrollado por Alain Colmerauer y Philippe Roussel. Este lenguaje permitía programación declarativa basada en resolución e inferencia lógica, estableciendo un paradigma donde los problemas se resolvían mediante deducción automática a partir de hechos y reglas predefinidas.

Algoritmos de Búsqueda y Planificación

Los algoritmos de búsqueda inteligente marcaron profundamente esta época. El algoritmo A* (1968), desarrollado por Hart, Nilsson y Raphael, fue inventado inicialmente para que el robot Shakey planificara rutas óptimas. Este algoritmo, que usa heurísticos para dirigir la búsqueda de manera eficiente, se convirtió en la columna vertebral de la IA clásica y sigue siendo fundamental en muchas aplicaciones modernas.

La lógica difusa, introducida por Lotfi Zadeh en 1965, representó un avance conceptual importante. Al permitir valores intermedios más allá del binario verdadero/falso, la lógica difusa encontró aplicaciones prácticas en sistemas de control, desde lavadoras hasta reguladores de tráfico, demostrando que la IA podía manejar la incertidumbre del mundo real.

El Renacer del Conexionismo (1980s-2000s)

La Revolución de la Retropropagación

El año 1986 marcó un punto de inflexión crucial con la popularización del algoritmo de retropropagación por Rumelhart, Hinton y Williams. Aunque el concepto matemático existía desde 1970, fue en los años 80 cuando se demostró su potencial para entrenar redes neuronales profundas. Esta técnica permitió solventar problemas complejos en visión por computadora y procesamiento de señales, disolviendo parcialmente la tradicional división entre enfoques simbólicos y conexionistas.

Métodos Estadísticos y Aprendizaje Automático

Los años 90 trajeron un enfoque más riguroso y estadístico al aprendizaje automático. Las Máquinas de Vectores de Soporte (SVM), introducidas por Cortes y Vapnik en 1995, se convirtieron en la herramienta preferida para clasificación debido a su robustez teórica y precisión en reconocimiento de patrones. Paralelamente, métodos como Random Forest (2001) y técnicas de boosting establecieron el paradigma de ensamblaje de modelos para mejorar la precisión mediante diversidad.

Las redes bayesianas, formalizadas por Judea Pearl en 1985, introdujeron un marco probabilístico riguroso para razonar bajo incertidumbre. Este enfoque permitió modelar relaciones de dependencia complejas y realizar inferencias causales, estableciendo las bases para el razonamiento probabilístico moderno.

La Revolución del Deep Learning (2006-2017)

El Despertar de las Redes Profundas

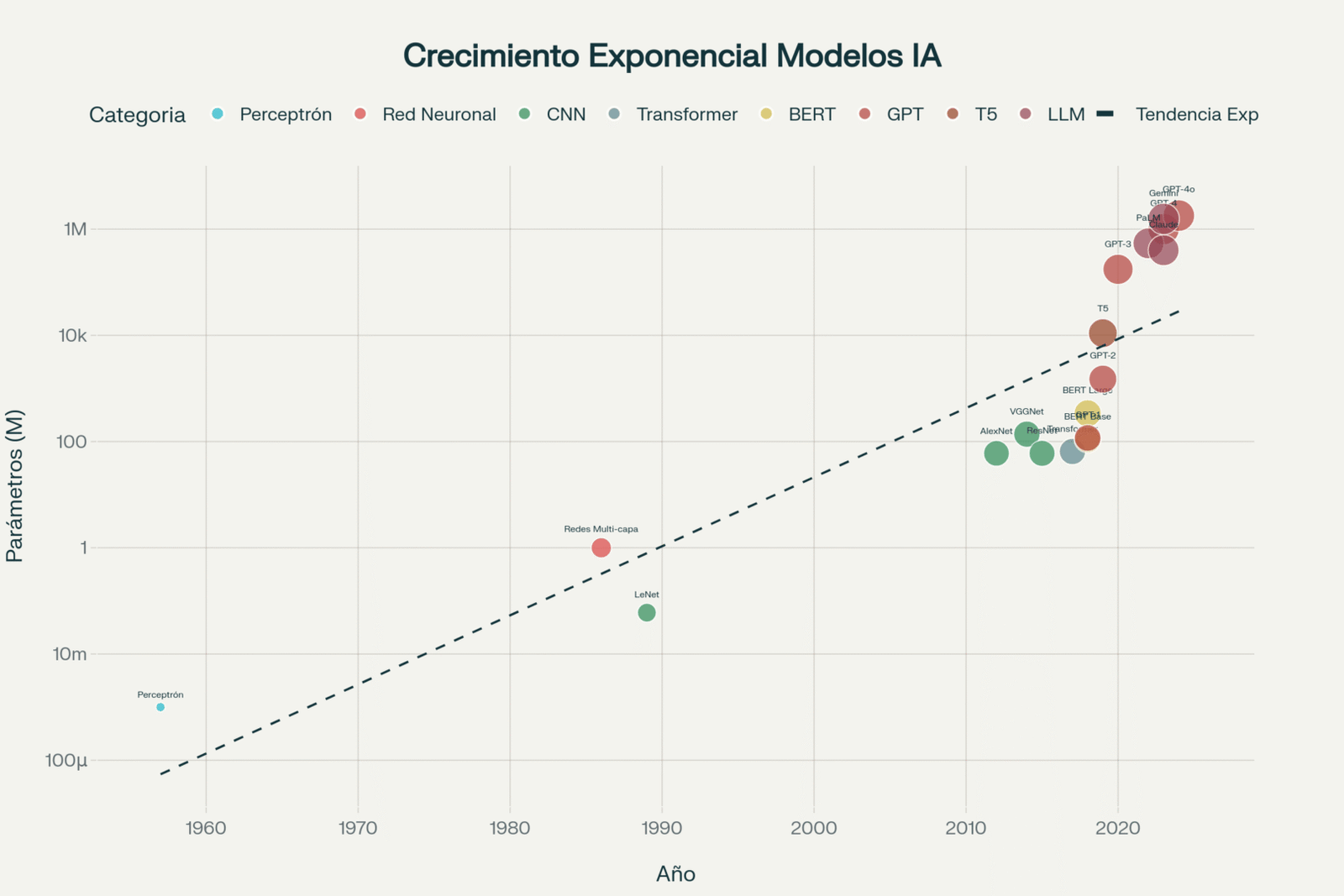

Aunque las redes neuronales profundas existían conceptualmente desde décadas atrás, fue a partir de 2006 cuando Geoffrey Hinton y sus colaboradores demostraron que era posible entrenar redes con muchas capas de manera efectiva. El término «deep learning» se popularizó, pero el verdadero momento eureka llegó en 2012 con AlexNet.

AlexNet: El Momento que Cambió Todo

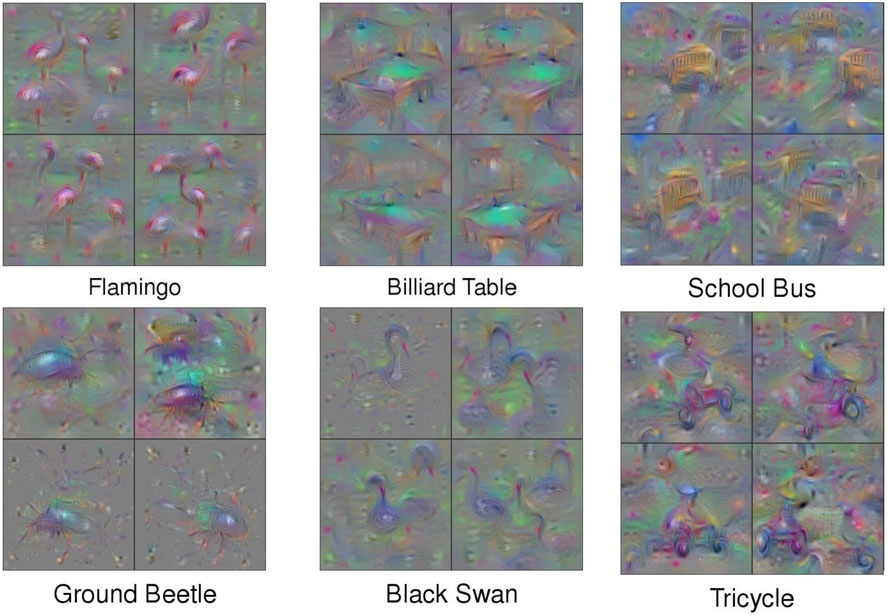

El 30 de septiembre de 2012 se considera el día que nació la revolución moderna del deep learning. AlexNet, desarrollada por Alex Krizhevsky, Ilya Sutskever y Geoffrey Hinton en la Universidad de Toronto, no solo ganó la competencia ImageNet, sino que la dominó completamente. Con un error del 15.3%, superó al segundo lugar por más de 10 puntos porcentuales, una diferencia impensable en competencias anteriores.

Lo revolucionario de AlexNet no fue solo su arquitectura, sino la convergencia de tres elementos clave: grandes volúmenes de datos etiquetados (ImageNet), entrenamiento en GPUs usando CUDA, y una arquitectura de red neuronal convolucional profunda. Todo esto se ejecutó en un entorno sorprendentemente modesto: un ordenador doméstico con dos tarjetas gráficas NVIDIA, en el dormitorio de Krizhevsky.

AlexNet demostró que las redes neuronales profundas podían superar décadas de investigación en visión por computadora tradicional. Su éxito catalizó una inversión masiva en deep learning y estableció las GPUs como la plataforma de entrenamiento estándar para modelos de IA a gran escala.

La Era de los Transformers: La Arquitectura que Cambió el Lenguaje (2017-2020)

«Attention Is All You Need»: Una Revolución en una Frase

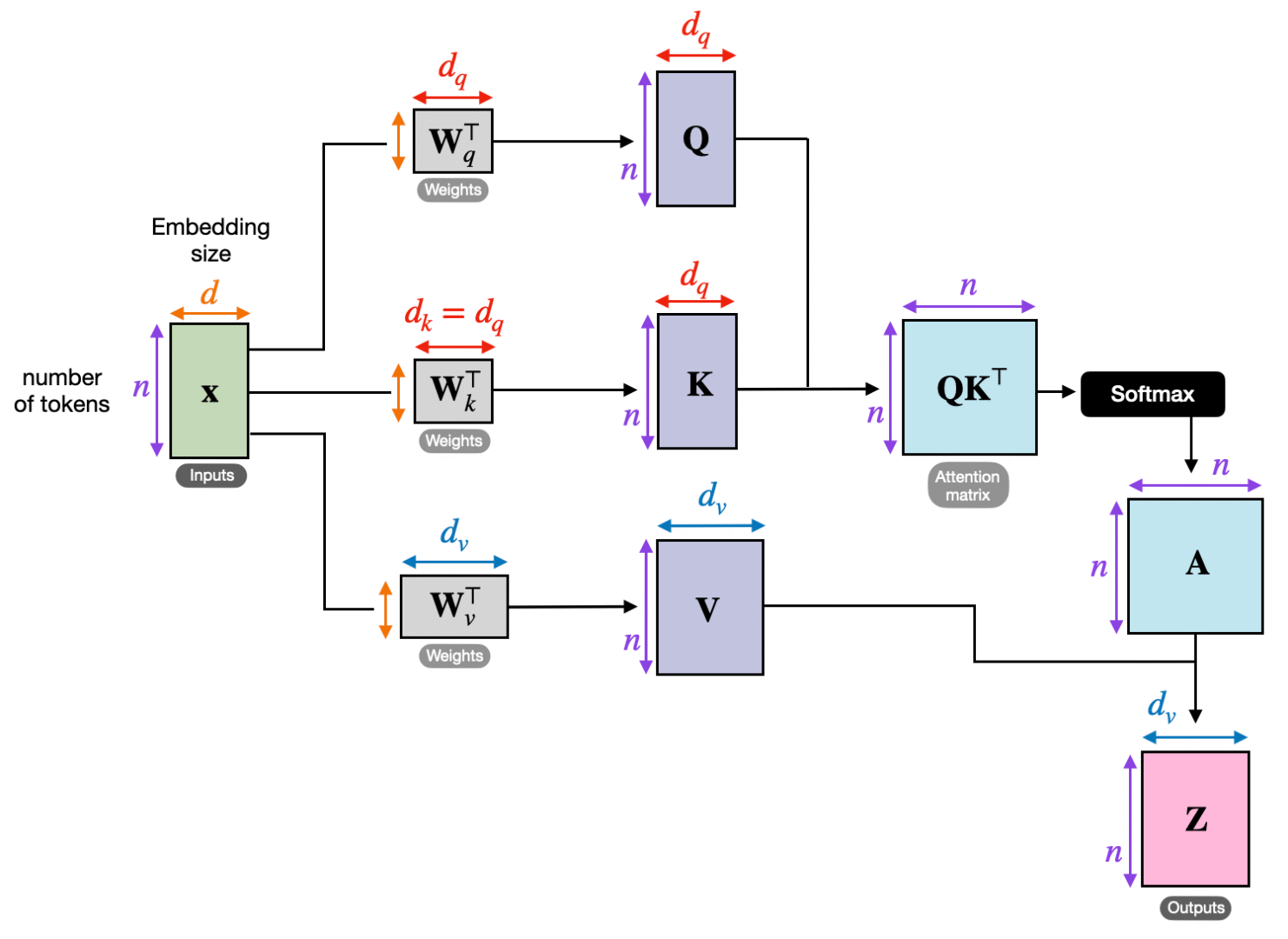

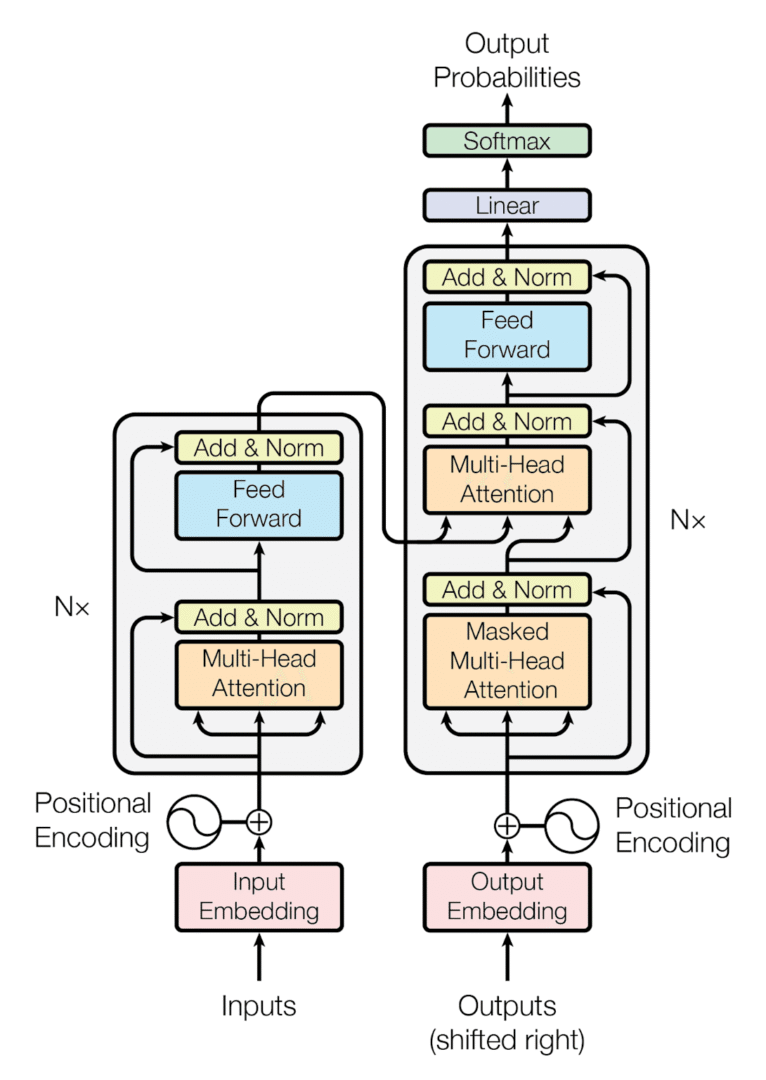

En junio de 2017, un grupo de investigadores de Google publicó un artículo con un título que se convertiría en profético: «Attention Is All You Need». Vaswani et al. introdujeron la arquitectura Transformer, que eliminaría la dependencia de recurrencias y convoluciones, sustituyéndolas por mecanismos de atención pura.

Los Transformers resolvieron problemas fundamentales de las arquitecturas anteriores: podían procesarse en paralelo (a diferencia de las RNNs), capturaban dependencias de largo alcance de manera más efectiva, y escalaban mejor con el aumento de datos y poder computacional. Esta arquitectura se convirtió en la base de prácticamente todos los grandes modelos de lenguaje modernos.

BERT y GPT: Dos Filosofías, Una Revolución

2018 fue un año extraordinario para el procesamiento de lenguaje natural. Google presentó BERT (Bidirectional Encoder Representations from Transformers), que revolucionó la comprensión del lenguaje mediante su enfoque bidireccional. BERT podía considerar el contexto tanto anterior como posterior a cada palabra, permitiendo una comprensión más profunda del significado textual.

Simultáneamente, OpenAI lanzó GPT-1 (Generative Pre-trained Transformer), enfocado en la generación de texto. Mientras BERT se especializaba en entender, GPT se concentraba en crear. Esta dualidad establecería dos líneas de desarrollo que convergirían posteriormente en modelos unificados.

La evolución de GPT-2 (2019) a GPT-3 (2020) marcó el salto hacia los modelos fundacionales. GPT-3, con sus 175 mil millones de parámetros, demostró capacidades emergentes sorprendentes: podía realizar tareas sin entrenamiento específico, utilizando solo few-shot learning a partir de ejemplos en el prompt.

La Era Actual: LLMs y la IA Conversacional (2020-presente)

El Fenómeno ChatGPT y la Democratización de la IA

Noviembre de 2022 marcó otro punto de inflexión histórico con el lanzamiento de ChatGPT. Basado en la arquitectura GPT-3 de aproximadamente 175 mil millones de parámetros y entrenado mediante Aprendizaje por Refuerzo con Retroalimentación Humana (RLHF), ChatGPT demostró que el afinamiento guiado por juicios humanos puede elevar drásticamente la calidad percibida de las respuestas sin necesidad de aumentar el tamaño del modelo. Esto estableció un nuevo paradigma: la alineación con las preferencias y valores de las personas es tan determinante para el éxito de un sistema de IA como la escala de su arquitectura.

Paradigmas Emergentes de Razonamiento

La era actual ha visto el desarrollo de sofisticadas técnicas de razonamiento que van más allá de la simple generación de texto. Chain-of-Thought (CoT) prompting, introducido por Wei et al. en 2022, permite que los modelos descompongan problemas complejos en pasos intermedios de razonamiento, mejorando dramáticamente su capacidad para resolver problemas lógicos y matemáticos.

Self-Consistency (Wang et al., 2022) refina este enfoque generando múltiples cadenas de pensamiento y seleccionando la respuesta por mayoría. Tree of Thoughts (2023) generaliza CoT a estructuras de razonamiento más complejas, permitiendo explorar múltiples rutas de solución simultáneamente.

Innovaciones de Vanguardia: Test-Time Compute y Deep Think

2024 y 2025 han introducido paradigmas que redefinen cómo pensamos sobre el cómputo en IA. Test-Time Compute, propuesto por Snell et al., demuestra que asignar dinámicamente más recursos computacionales durante la inferencia puede ser más efectivo que simplemente aumentar el tamaño del modelo. Esta aproximación permite que modelos más pequeños superen a gigantes computacionales en tareas específicas mediante cómputo adaptativo.

Deep Think with Confidence, desarrollado por equipos de Meta AI en 2025, representa la frontera más avanzada del razonamiento artificial. Este método evalúa la confianza interna del modelo en cada paso del razonamiento, descartando tempranamente trayectorias de pensamiento inseguras. Los resultados son impresionantes: puede reducir hasta 84% el cómputo generado mientras alcanza casi 100% de precisión en pruebas matemáticas complejas.

Hacia el Futuro: Agentes Autónomos y IA Híbrida

La Convergencia de Paradigmas

El futuro de la IA parece dirigirse hacia la convergencia de múltiples paradigmas. Los modelos modernos integran capacidades multimodales (visión, diálogo, acciones), mientras que las arquitecturas neuro-simbólicas combinan la flexibilidad de las redes neuronales con la robustez lógica de los sistemas expertos tradicionales.

Agentes Autónomos: La Próxima Frontera

Los agentes de IA autónomos (2023-2025) representan quizás la evolución más prometedora. Estos sistemas pueden planificar y ejecutar secuencias de acciones complejas para lograr objetivos, interactuando con software y potencialmente con el mundo real. La visión emergente es de sistemas que actúen como orquestadores de tareas complejas, descomponiendo objetivos en subtareas, asignándolas a otros sistemas o humanos, y supervisando su ejecución.

Reflexiones Finales: Lecciones del Pasado, Visión del Futuro

Patrones de Evolución

Analizando 75 años de evolución en IA, emergen patrones claros. Cada paradigma no reemplaza completamente al anterior, sino que se construye sobre él. Los sistemas modernos combinan lógica simbólica para razonamiento estructurado, redes neuronales para reconocimiento de patrones, métodos estadísticos para incertidumbre, y mecanismos de atención para procesamiento contextual.

Los Momentos de Inflexión

Los verdaderos saltos evolutivos en IA han ocurrido cuando tres factores convergen: nuevas arquitecturas algorítmicas, disponibilidad de datos a gran escala, y poder computacional suficiente. Esto sucedió con AlexNet en 2012, con los Transformers en 2017, y está ocurriendo nuevamente con los agentes autónomos y el razonamiento avanzado.

Hacia Dónde Vamos

Estamos en el umbral de una nueva era donde la IA no solo procesa información, sino que razona, planifica y actúa de manera autónoma. Las tendencias actuales hacia el aprendizaje causal, el cómputo cuántico para IA, y la integración multimodal avanzada sugieren que los próximos años verán avances tan dramáticos como los que hemos presenciado.

La historia de la IA es, en última instancia, la historia de la búsqueda humana por comprender y replicar la inteligencia. Cada paradigma, desde el Test de Turing hasta Deep Think with Confidence, representa un paso más en este viaje extraordinario. Y si la historia nos enseña algo, es que los mayores avances están aún por llegar.

Hoy, cuando interactuamos con ChatGPT o vemos cómo la IA genera arte, código y literatura, estamos presenciando la materialización de sueños que comenzaron hace tres cuartos de siglo en una conferencia de verano en Dartmouth. La inteligencia artificial ha evolucionado, de ser una especulación teórica, a convertirse en la tecnología más transformadora de nuestro tiempo, y su evolución apenas ha comenzado…

- https://techncleo.com/historia-de-la-inteligencia-artificial/

- https://inteligenciaartificial360.com/fundamentos-ia/modelos-de-lenguaje/modelos-de-lenguaje-basados-en-transformers-conceptos-basicos-y-avances/

- https://revistacloud.com/codigo-cambio-historia-alexnet-red-neuronal-revoluciono-inteligencia-artificial/

- https://inlocrobotics.com/es/evolucion-de-la-inteligencia-artificial/

- https://www.ebiseducation.com/modelos-transformers-que-son-y-como-funcionan

- https://www.pinecone.io/learn/series/image-search/imagenet/

- https://www.ubiqo.net/tecnologia/evolucion-inteligencia-artificial/

- https://helm-nagel.com/es/bert-frente-a-gpt-analisis-en-profundidad-de-los-modelos-linguisticos-de-la-ai/

- https://administraciondesistemas.com/alexnet-el-codigo-que-encendio-la-revolucion-del-deep-learning-ya-es-publico/

- https://serenitystar.ai/es/blog/la-evolucion-de-la-inteligencia-artificial-a-lo-largo-del-tiempo

- https://es.linkedin.com/pulse/la-evolución-de-los-modelos-lenguaje-gran-tamaño-llms-elúa-samaniego-g6xhf

- https://en.wikipedia.org/wiki/AlexNet

- https://es.wired.com/articulos/historia-de-la-inteligencia-artificial-en-10-fechas-clave

- https://atlastecnologico.com/la-revolucion-de-los-modelos-de-lenguaje-desafiando-los-limites-de-la-ia-y-la-creatividad-humana/

- https://www.youtube.com/watch?v=07pnnfHaQCA

- https://adrianvillegasd.com/breve-historia-de-la-evolucion-de-la-inteligencia-artificial/

- https://www.growketing.com/ia-generativa-como-transformers-bert-y-gpt-estan-cambiando-el-marketing-digital/

- https://www.nationalgeographic.com.es/ciencia/breve-historia-de-la-inteligencia-artificial_19310

- https://www.automatizapro.com.ar/blog/historia-transformers-ia-bert-gpt4/